Documentation Index

Fetch the complete documentation index at: https://docs.openzero.com.br/llms.txt

Use this file to discover all available pages before exploring further.

Visão geral

OpenZero permite criar conteúdo visual de alta qualidade a partir de descrições de texto simples (prompts) ou imagens de referência. Gere imagens ou vídeos dinâmicos em qualquer estilo, depois refine-os iterativamente com prompts adicionais, aumente a resolução para saída em alta definição e até adicione sincronização labial com áudio. Exporte os recursos finalizados como arquivos independentes ou importe-os diretamente para edição.A plataforma está sendo sempre atualizada, com os melhores modelos e recursos adicionados quase a cada semana.

Guia

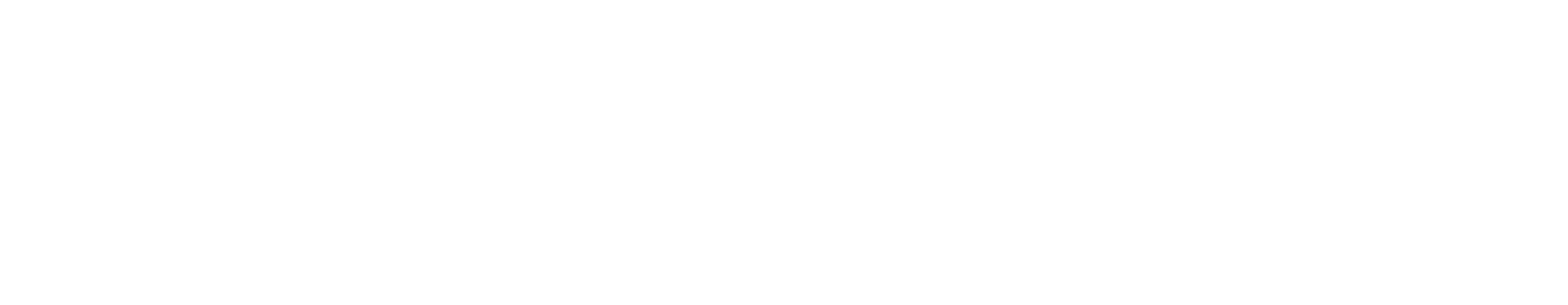

Siga estes passos para criar seu primeiro asset visual:1 Selecione seu workflow

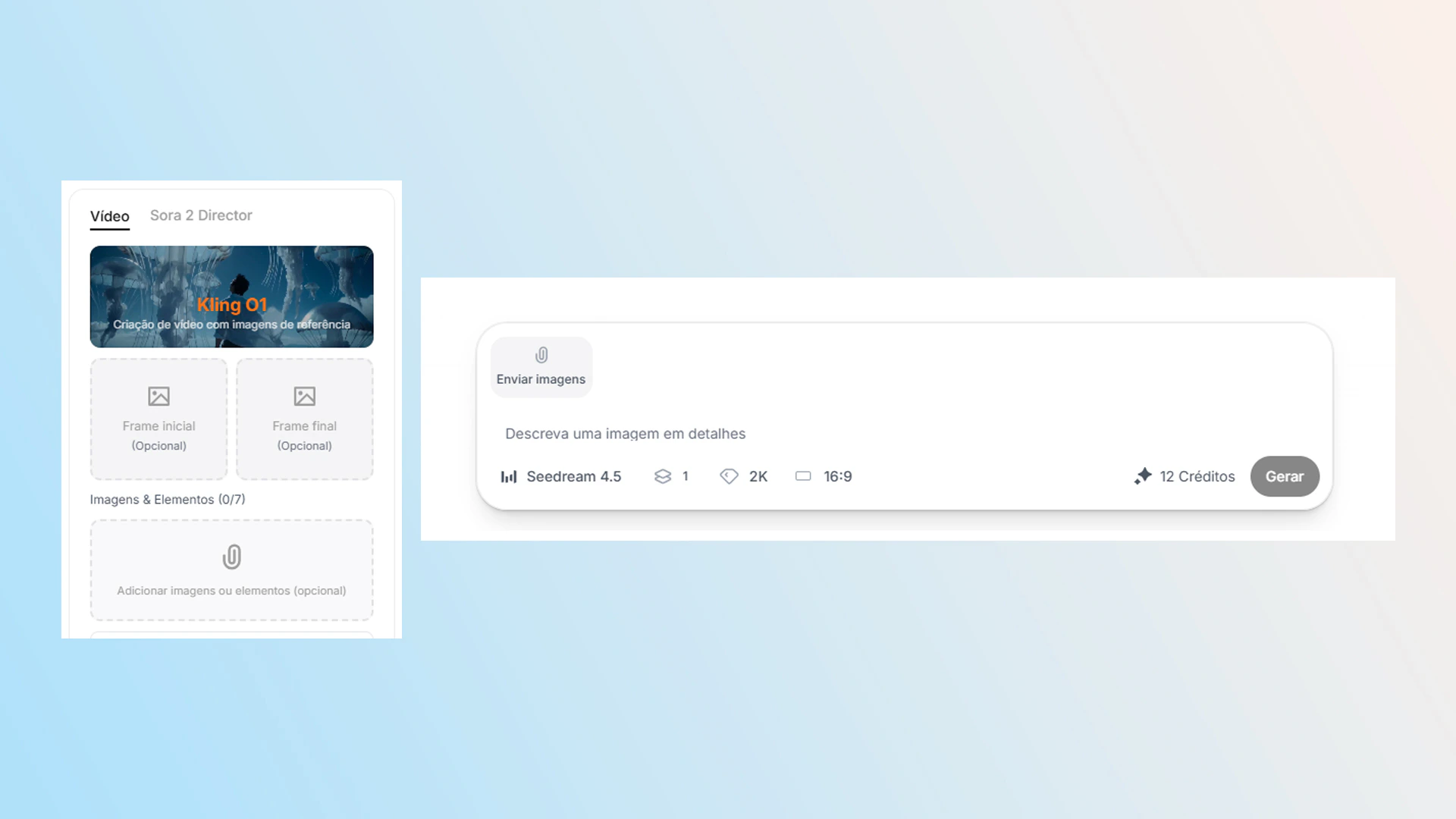

Use os atalhos na ‘Home’ para escolher entre geração de Imagem ou Vídeo.2 Forneça um prompt ou referência

Descreva o resultado desejado usando linguagem natural na caixa de prompt, de preferência em inglês para conseguir os melhores resultados. Para mais controle, arraste imagens ou vídeos existentes nas abas Explorar ou Histórico para os espaços de referência/imagens, ou faça upload de suas próprias imagens de referência em diversos formatos de arquivo: JPG, PNG ou WEBP.3 Escolha um modelo e configurações

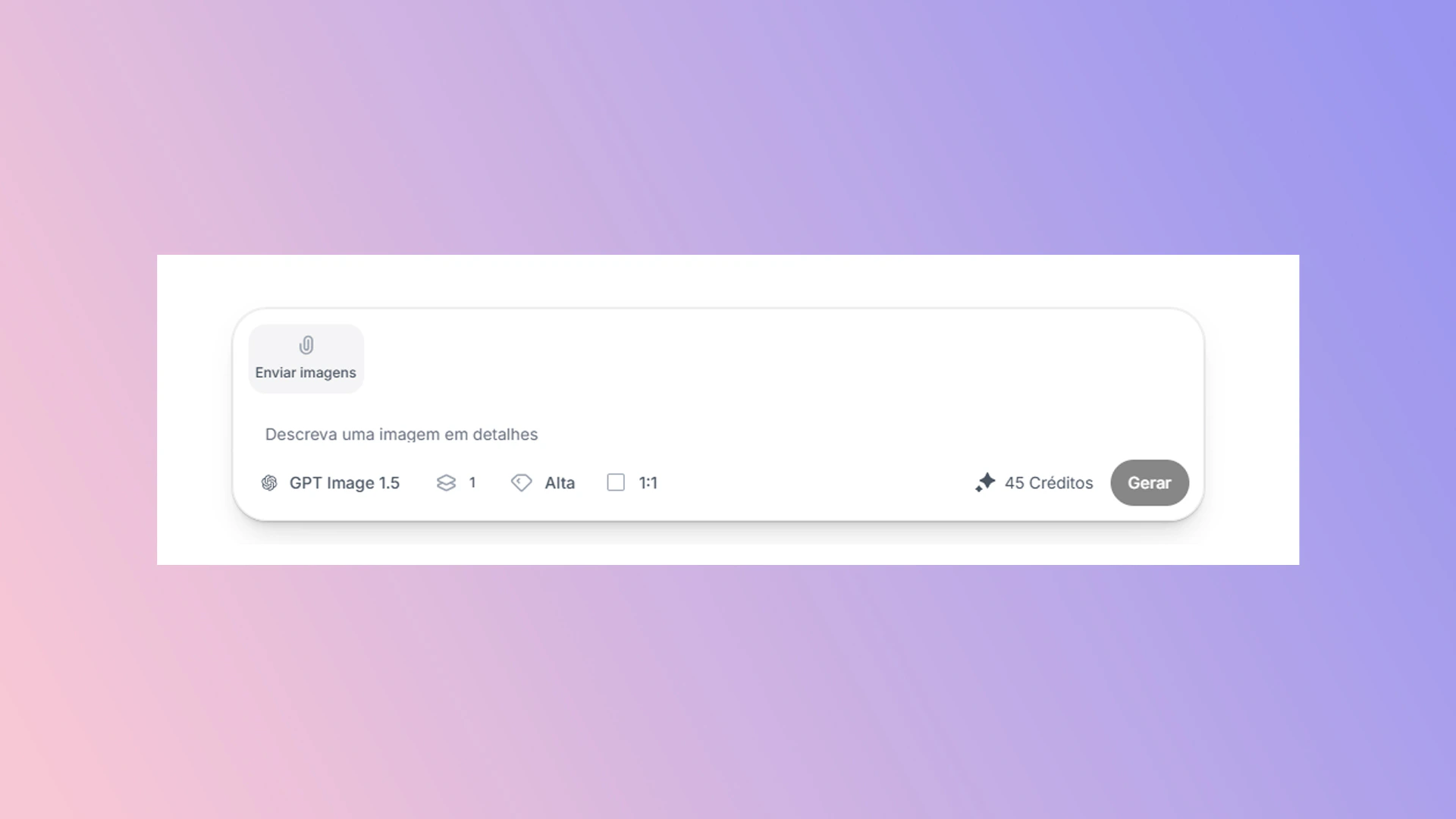

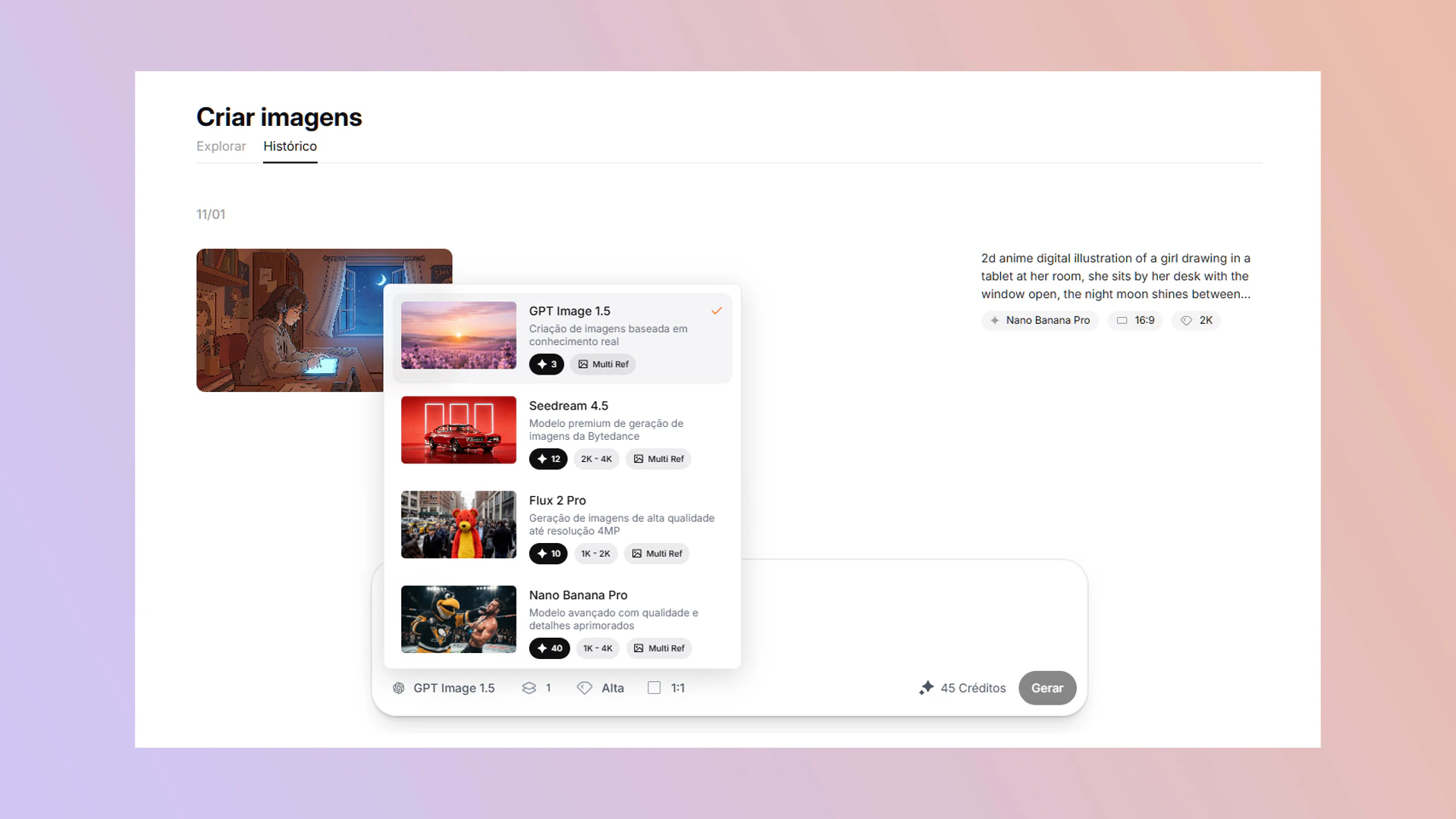

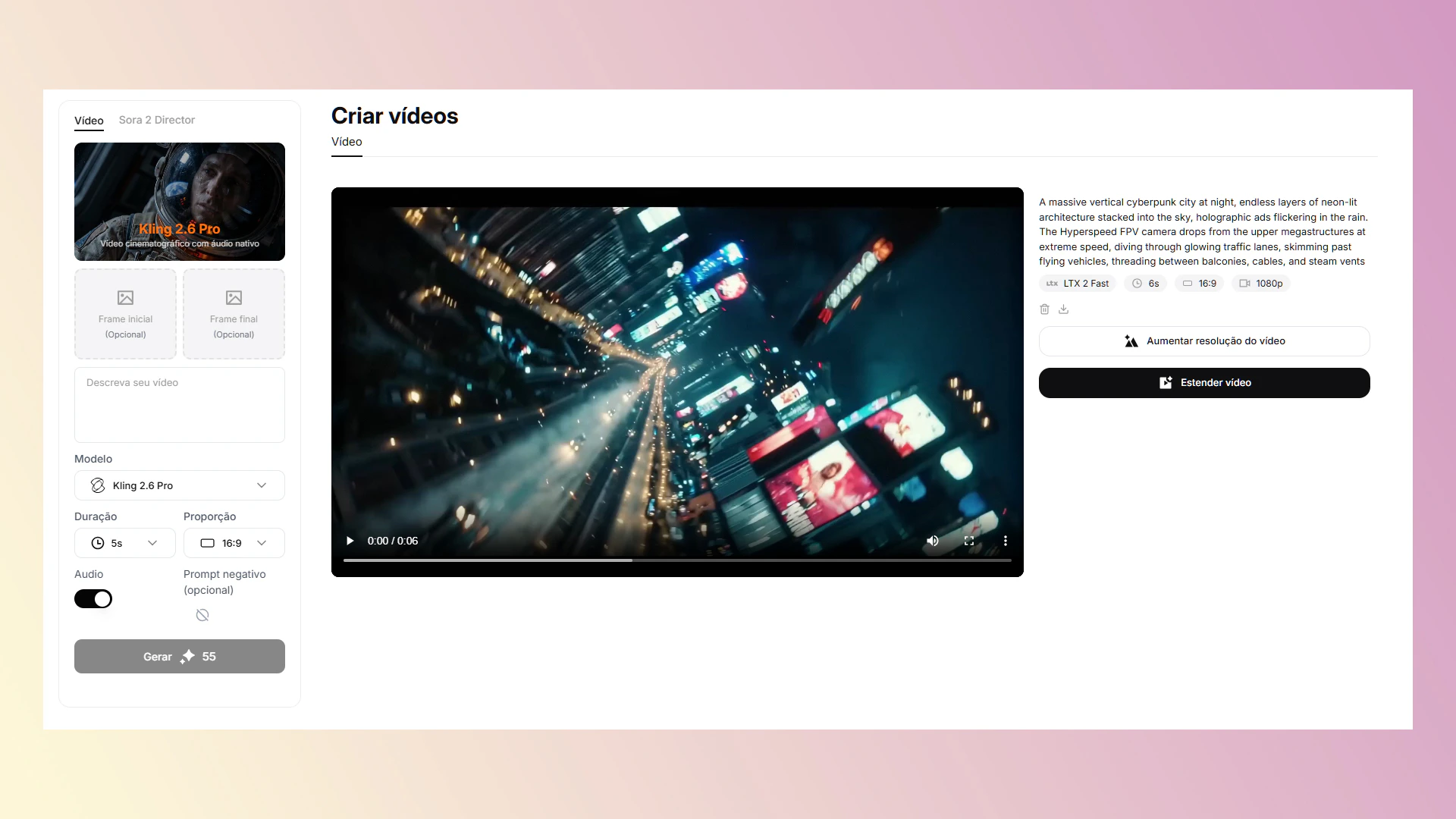

Selecione o modelo de IA generativa ideal para seu objetivo (ex: OpenAI Sora 2 Pro, Kling 2.6 pro, Flux 2 Pro, Seedream 4.5 etc). Consulte a seção Modelos para informações detalhadas sobre cada modelo. Ajuste configurações como proporção de tela, resolução, duração (para vídeo) e o número de variações a serem geradas. Note que os fluxos de criação de imagem e vídeo têm interfaces diferentes, mas visualmente coesas, a fim de oferecerem o melhor em termos de uso para cada modelo.4 Gere seu asset

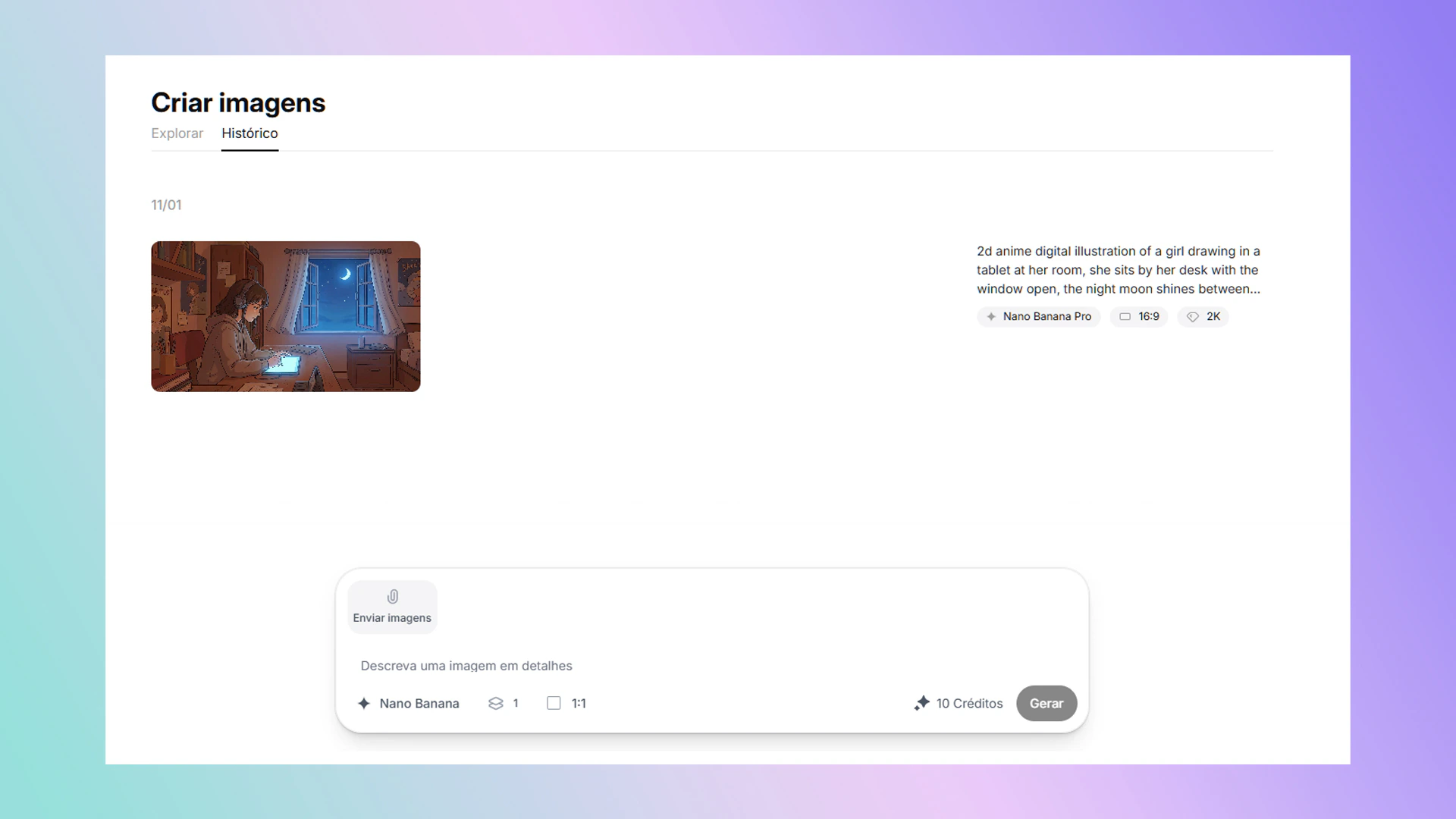

Clique no botão Gerar. Seus assets de imagem serão criados e exibidos na aba Histórico para revisão, com os detalhes da imagem criada. Em Explorar, você poderá clicar para visualizar a imagem em tamanho maior. Já para vídeos, os assets criados são exibidos numa mesma visualização. Em ambos os workflows, ao clicar nos prompts em Criar vídeo ou no Histórico (para imagens), os textos são carregados automaticamente na seção de prompts.5 Aprimore e refine

Use o modelo de aprimoramento da Topaz para aperfeiçoar sua mídia. Faça upscale da resolução para imagens e vídeos e deixe seus assets prontos para uso. Se quiser, envie sua imagem para a seção de vídeo e aplique sincronização labial realista com áudio. Na seção “Criar vídeos”, clique em Estender vídeo para gerar uma continuação da história a partir do último frame do vídeo.6 Salve sua criação

Baixe o asset como arquivo independente.Fluxo de trabalho

O processo de criação conduz você da inspiração ao asset finalizado em três etapas:Gerar

Use a caixa de prompt para descrever o que você quer criar, selecione um modelo, ajuste suas configurações e dê vida à sua ideia.Histórico

Revise suas gerações na aba Histórico (imagens) ou na própria seção Criar vídeos para iterar e aprimorar. Recrie variações, reutilize prompts e aplique aprimoramentos como upscaling e sincronização labial.Salvar

Baixe assets finalizados em vários formatos.Gerar imagens e vídeos

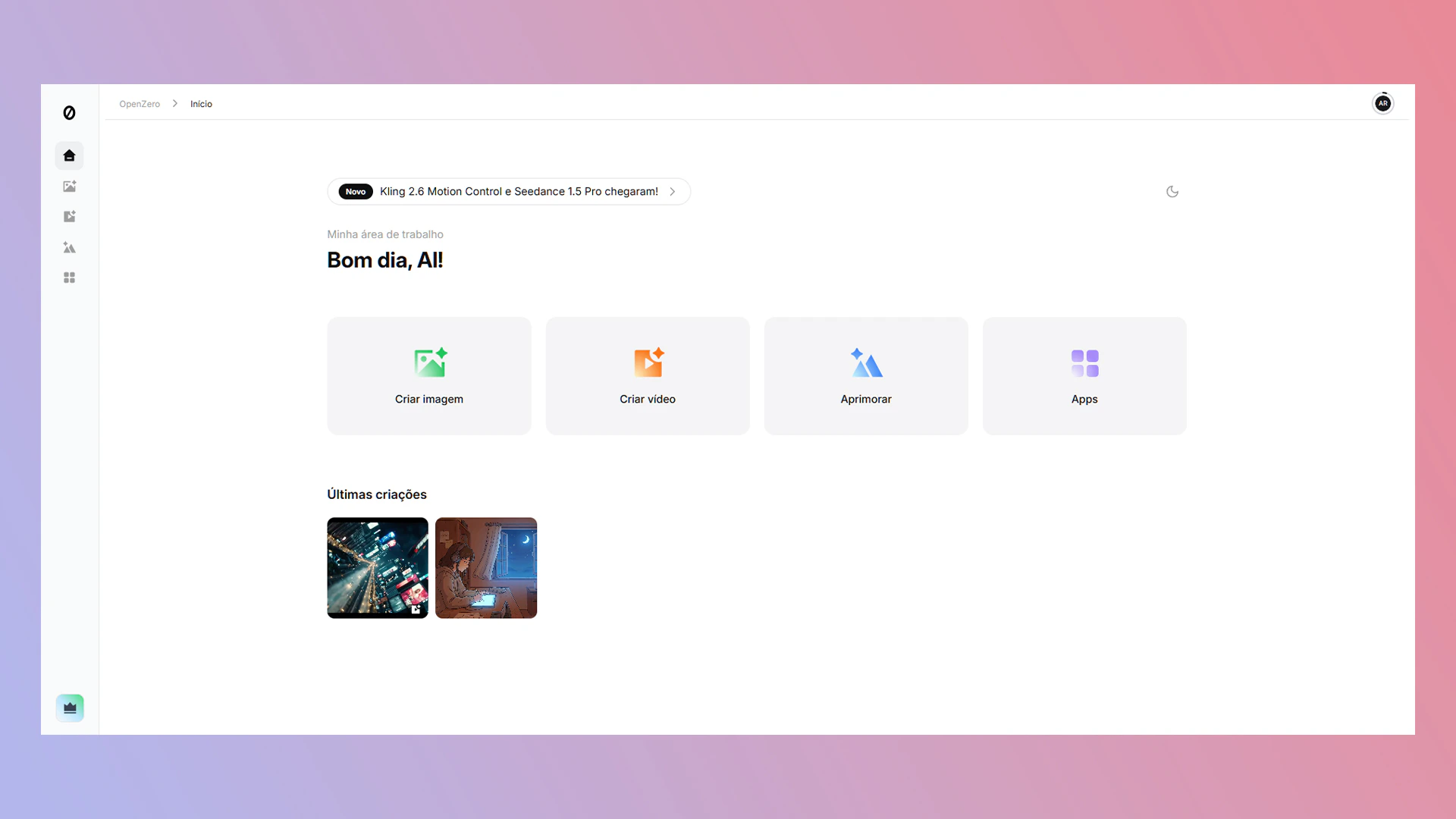

Defina o prompt

Escreva seu prompt: No campo principal, descreva o que você quer gerar usando linguagem natural, preferencialmente em inglês. Seja claro e descritivo para obter melhores resultados.Escolha modelos e configurações

- Proporção de Tela: Controle as dimensões da sua saída

- Resolução: Defina o nível de qualidade

- Duração: Especifique a duração do vídeo (para modo vídeo)

- Número de Gerações: Crie até 4 variações de uma vez (por enquanto, apenas para imagens).

Adicione referências

Gere o asset

Antes de gerar, um indicador de custo por créditos mostra o valor total correspondente ao número de recursos que você escolheu criar e modelo escolhido. Quando estiver pronto, clique em Gerar. Suas novas criações aparecerão na aba Histórico em Criar imagem e na própria seção em Criar vídeo.Criações

Imagens

Vídeos

Formatos de download suportados

📹 Vídeo:- MP4: Codecs H.264, H.265. Qualidade até 4K (com upscaling)

- PNG ou JPG (varia com o modelo): Saída em alta resolução de até 4K, sem perdas

Modelos

OpenZero oferece acesso a modelos especializados otimizados para diferentes casos de uso. Cada modelo apresenta capacidades únicas, desde iteração rápida até qualidade pronta para produção. Modelos de pós-processamento exigem um resultado já gerado, embora você também possa enviar seu próprio arquivo de imagem ou vídeo./Imagem

Nano Banana Pro

Nano Banana Pro

Modelo do Google com alta resolução de até 4K para geração e edição de alta qualidade de imagens a partir de prompts de texto.Recursos:

- Suporta até 11 referências de imagem para orientar a geração

- Gera até 4 imagens por vez

- Proporções: 21:9, 16:9, 5:4, 4:3, 3:2, 1:1, 2:3, 3:4, 4:5, 9:16

- Criação e iteração de imagens com alta qualidade e prontas para uso

GPT Image 1.5

GPT Image 1.5

Um modelo versátil da OpenAI para criação e edição de imagens com alto nível de precisão, usando linguagem natural como principal forma de controle.Foi desenhado para quem precisa direcionar o visual com clareza.Recursos principais

- Aceita até 9 imagens de referência para guiar estilo, composição e detalhes

- Gera até 4 variações por execução, facilitando comparação e escolha

- Mantém boa fidelidade ao prompt mesmo em edições e ajustes finos

- Proporções: 3:2, 1:1, 2:3

- Qualidade: low, medium, high, equilibrando custo e definição conforme o uso

- Criação de imagens orientadas por texto com controle real

- Edição visual (ajustes, variações, iterações) sem precisar refazer tudo do zero

- Workflows de design, marketing, produto e prototipagem visual

Seedream 4.5

Seedream 4.5

Um modelo de imagem especializado para gerar sequências de múltiplos quadros ou cenas com grande movimento e ação.Recursos:

- Excelente na criação de imagens com física estável e transições coerentes

- Aceita até 11 referências de imagem para orientar a geração

- Gera até 4 imagens por vez

- Proporções: automático, 16:9, 4:3, 1:1, 3:4, 9:16

- Cenas de ação e composições dinâmicas

Nano Banana

Nano Banana

Primeira versão do modelo do Google com alta velocidade para geração e edição rápida e de qualidade de imagens a partir de prompts de texto.Recursos:

- Suporta múltiplas referências de imagem para orientar a geração

- Gera até 4 imagens por vez

- Proporções: 21:9, 16:9, 5:4, 4:3, 3:2, 1:1, 2:3, 3:4, 4:5, 9:16

- Criação e iteração rápida de imagens

Flux 2 Pro

Flux 2 Pro

Um modelo profissional para geração e edição avançada de imagens, oferecendo forte coerência de cena e controle de estilo.Recursos:

- Controle de estilo baseado em imagem, exigindo uma imagem de referência para orientar a estética visual

- Aceita até 9 imagens de referência

- Gera até 4 imagens por vez

- Proporções: 21:9, 16:9, 4:3, 3:2, 1:1, 2:3, 3:4, 4:5, 9:16, 9:21

- Conteúdo profissional com requisitos precisos de estilo

Imagen 4

Imagen 4

Modelo de geração de imagens do Google focado em qualidade visual, realismo e coerência estética a partir de descrições em linguagem natural.Recursos principais

- Geração de imagens com alto nível de realismo e iluminação natural

- Forte consistência de estilo dentro de uma mesma execução

- Boa interpretação de cenas, ambientes e composição

- Proporções variadas (dependendo da integração) de até 2K

- Qualidade otimizada automaticamente para fidelidade visual

- Criar imagens finais para campanhas, social, concept art e mockups

- Cenas, personagens e ambientes com estética bem resolvida

- Quando você quer algo que “já parece pronto” sem muito retrabalho

GPT Image 1 Mini

GPT Image 1 Mini

Um modelo leve, mas poderoso, da OpenAI para geração de imagens rápidas a partir de texto, focado em velocidade, custo baixo e iteração ágil.É feito para testar ideias visualmente ou projetos que não requerem alta resolução.Recursos principais

- Geração rápida com baixo custo computacional

- Ideal para criar rascunhos visuais, variações e conceitos iniciais

- Boa interpretação de prompts simples e estilos amplos

- Proporções básicas (dependendo da integração)

- Qualidade otimizada para preview e exploração, não para entrega final

- Brainstorming visual

- Moodboards, wireframes visuais, thumbnails

- Prototipagem de ideias antes de passar para modelos mais pesados

Vídeo

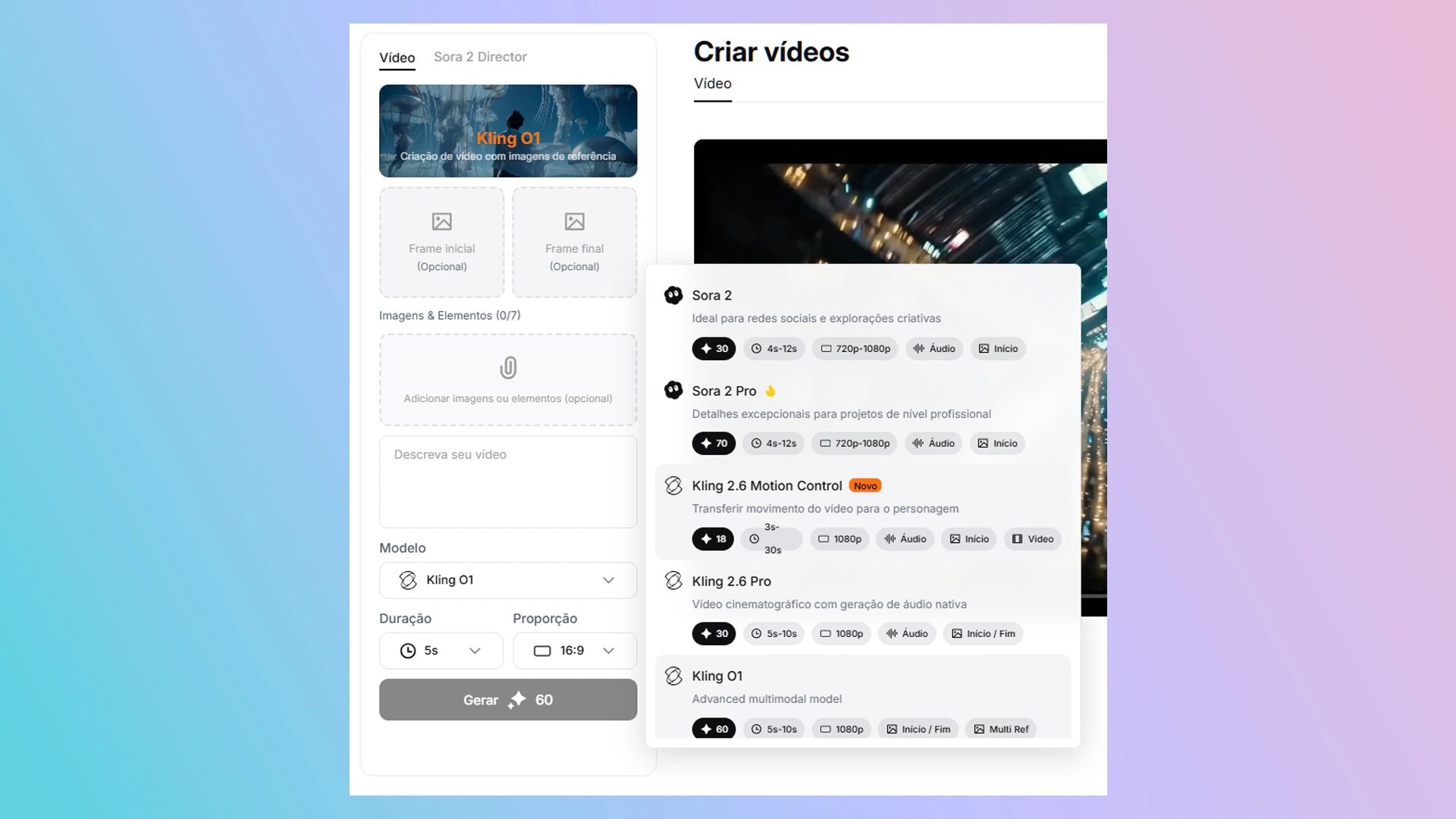

Sora 2 Pro

Sora 2 Pro

O modelo de vídeo da OpenAI mais avançado e de alta fidelidade para resultados cinematográficos à sua disposição.Entradas de geração:

- Texto para Vídeo

- Quadro inicial

- Saída de altíssima fidelidade, nível profissional, com áudio sincronizado

- Controle preciso de múltiplos quadros

- Excelente em movimentos complexos e aderência ao prompt

- Durações fixas: 4s, 8s e 12s

- Criação em lote com até 4 gerações por vez

- Resoluções: 720p, 1080p

- Proporções: 16:9, 9:16

- Conteúdo de vídeo cinematográfico em nível profissional

Sora 2

Sora 2

A versão padrão e de alta velocidade do modelo avançado de vídeo da OpenAI, ajustada para criação de conteúdo do dia a dia.Entradas de geração:

- Texto para Vídeo

- Quadro inicial

- Vídeos realistas, com consciência física e áudio sincronizado

- Controle refinado de cena

- Durações fixas: 4s, 8s e 12s

- Criação em lote com até 4 gerações por vez

- Forte consistência narrativa e de personagens

- Resoluções: 720p, 1080p

- Proporções: 16:9, 9:16

- Criação de conteúdo cotidiano com física realista

Kling 2.6 Pro

Kling 2.6 Pro

Modelo avançado de geração de vídeo por IA focado em controle de movimento, consistência visual e direção de cena a partir de prompts e referências.Ele é menos sobre “surpresa criativa” e mais sobre executar exatamente o que você dirige.Recursos principais

- Frame inicial e final

- Controle preciso de movimento de câmera, corpo e objetos

- Suporte a imagens de referência para manter personagens e cenários consistentes

- Ótima coerência temporal entre frames (menos “derretimento” visual)

- Ideal para cenas com ação, coreografia e tracking de câmera

- Resoluções até 1080p

- Duração variável por clipe (dependendo da integração)

- Estilos cinematográficos, realistas ou estilizados

- Reels, trailers, cenas de filme e comerciais em vídeo

- Conteúdo com movimento coreografado

- Quando você precisa que a IA “obedeça o diretor”, não apenas improvise

Seedance 1.5 Pro

Seedance 1.5 Pro

Modelo de geração de vídeo por IA projetado para produção consistente, previsível e escalável de clipes a partir de texto e referências visuais.É orientado a workflows de produção, não a experimentação artística aleatória.Recursos principais

- Frame inicial e final

- Geração de vídeo com alta estabilidade temporal

- Suporte a imagens de referência para personagens, cenários e estilo

- Boa preservação de identidade visual entre frames

- Adequado para pipelines de conteúdo e automação

- Resoluções até 1080p

- Durações configuráveis por clipe

- Perfis de qualidade balanceados entre custo e fidelidade visual

- Criação de vídeos para marketing, social media e produto

- Produção de múltiplas variações de uma mesma cena

- Plataformas que exigem previsibilidade, não apenas criatividade

Kling O1

Kling O1

Motor multimodal de vídeo por IA que combina texto, imagens e vídeo como entrada para gerar, editar e continuar cenas com coerência visual e controle direcional avançado.Recursos principais

- Multimodalidade nativa: aceita prompt de texto, imagens de referência (elementos/objetos/personagens) e vídeo de entrada para geração orientada por contexto.

- Geração e edição de vídeo: text-to-video, image-to-video e edição por linguagem natural — sem necessidade de mascaramento tradicional, tracking ou keyframing.

- Consistência de cena e personagens: mantém rostos, roupas, objetos e cenários estáveis em múltiplos cortes e ângulos quando referenciados.

- Controle criativo unificado: combina tarefas como adição de sujeito + mudança de fundo + restyling em uma única chamada de API.

- Continuidade e sequência: suporte a frames inicial/final e referência de vídeo para conectar tomadas com linguagem cinematográfica coerente.

- Vídeo em formato MP4 com controle de duração e proporção conforme parâmetro da integração.

- Saídas coerentes de movimento e linguagem visual entre frames e cenas subsequentes.

- Produção de vídeo profissional com narrativa contínua ou cenas sequenciais.

- Edição baseada em texto — alterar elementos de cena, mudar iluminação ou restilar personagens diretamente por prompt.

- Pipelines de conteúdo escaláveis que exigem saída previsível, reutilização de ativos e consistência visual.

Kling 2.6 Motion Control

Kling 2.6 Motion Control

Tecnologia de transferência de movimento por IA incorporada ao Kling Video 2.6, projetada para capturar e aplicar movimento real extraído de vídeos de referência a imagens estáticas, gerando vídeos com controle preciso de ação, postura e expressões.Recursos principais

- Transferência de movimento baseada em referência: importa movimentos de um vídeo de 3 a 30 segundos e aplica diretamente a uma imagem de personagem.

- Captura de corpo completo e detalhes finos: preserva postura, gestos de mãos e expressões faciais com alta fidelidade temporal — inclusive em ações rápidas e coreografias.

- Orientação de personagem flexível: permite ajustar o enquadramento da ação usando modos que mantêm o personagem alinhado ao vídeo de referência ou à composição da imagem original.

- Refinamento de cena via prompt: além do movimento, prompts de texto podem ajustar cenário, iluminação, atmosfera e estilo visual sem afetar a transferência de movimento.

- Controle opcional de áudio: possibilidade de manter o áudio original da referência ou gerar saída silenciosa para pós-produção sonora.

- Geração de vídeo de 3 a 30 segundos em 720p ou 1080p, com movimento contínuo e coerente.

- Suporte a múltiplos formatos de referência (imagem e vídeo)

- Animação de personagens com movimento realista diretamente a partir de vídeos de referência.

- Produção de conteúdo visual com ações específicas (dança, esporte, gestos) sem rigging ou pipelines tradicionais de mocap.

- Criação de vídeos para social media, marketing e storytelling que dependem de transferência de movimento previsível e estável.

LTX 2 Pro

LTX 2 Pro

Versão avançada do LTX, orientada a qualidade visual, consistência e controle de cena.Equilibra velocidade com fidelidade estética.Recursos principais

- Melhor coerência temporal que o LTX Fast

- Maior estabilidade de personagens e objetos

- Interpretação mais precisa de prompts

- Resoluções e durações superiores ao Fast

- Perfis de qualidade configuráveis

- Conteúdo comercial e institucional

- Vídeos de produto e marketing

- Produção recorrente com padrão visual definido

LTX 2 Fast

LTX 2 Fast

Modelo de vídeo otimizado para velocidade máxima e custo reduzido, com foco em geração em massa.Não é um modelo cinematográfico — é um motor de testes e gerações para redes sociais.Recursos principais

- Renderização acelerada

- Baixo custo por clipe

- Boa estabilidade para cenas simples e loops

- Durações curtas

- Qualidade voltada para preview e distribuição rápida

- Conteúdo em escala (feeds, ads, variações de criativos)

- Testes A/B visuais

- Automação de vídeos

OmniHuman 1.5

OmniHuman 1.5

Modelo avançado de sincronização labial realista voltado à criação de humanos e personagens digitais dinâmicos e cinematográficos a partir de imagem e áudio.Projetado para workflows profissionais, ele vai além de avatares estáticos: personagens podem se mover, reagir e interagir de forma realista.Recursos principais

- Geração de atores digitais com movimento corporal completo, gestos naturais e expressões faciais fluidas

- Controle de cena e de personagem por texto e áudio, incluindo orientações de câmera e timing

- Suporte a cenários com múltiplos personagens interagindo de forma coerente

- Interpretação semântica de áudio que alinha ação e expressão ao conteúdo falado

- Vídeos com qualidade cinematográfica, com composição de cena, movimentos planejados e depth

- Controle de ângulos de câmera, zoom e enquadramento via prompt

- Saídas ajustáveis conforme necessidade de produção

- Produção de conteúdo audiovisual profissional: marketing, institucional, treinamentos

- Criação de personagens digitais realistas para vídeos narrativos

- Integração em pipelines de vídeo com atores virtuais em escala

- Aplicações educacionais, corporativas e comerciais que exigem performance digital realista